Ove nedelje, OpenAI je lansirao ono što je njegov izvršni direktor, Sem Altman, nazvao „najpametnijim modelom na svetu“— generativni AI program čije su sposobnosti navodno daleko naprednije i bliže ljudskom načinu razmišljanja od svih prethodnih softverskih rešenja ove vrste.

Kompanija je radila na ovom trenutku od 12. septembra, dana za koji OpenAI tvrdi da je označio novi pravac ka superinteligenciji.

Nove verzije serije AI modela

Tog dana, kompanija je predstavila rane verzije serije AI modela poznatih kao o1, razvijenih uz nove metode za koje OpenAI veruje da će njihove programe podići na neviđene visine.

Mark Čen, tadašnji potpredsednik za istraživanja u OpenAI-u, izjavio je nekoliko dana kasnije da je o1 fundamentalno drugačiji od standardnog ChatGPT-a jer može „razmišljati“, što se smatra ključnim obeležjem ljudske inteligencije. Nedugo zatim, Altman je proglasio „početak doba inteligencije“, u kojem će AI pomagati čovečanstvu da rešava klimatske promene i kolonizuje svemir.

Od 5. decembra, kompanija je javnosti učinila dostupnom prvu potpunu verziju modela o1, sa u potpunosti razvijenim sposobnostima rezonovanja.

Oprezni entuzijazam i kritike

Na prvi pogled, najnovija retorika OpenAI-a deluje poput marketinškog „hajpa“ na kojem je kompanija izgradila svoju vrednost od 157 milijardi dolara. Javnosti nije poznato kako tačno OpenAI razvija svoju tehnologiju chatbotova, a o1 je njihovo najtajnovitije izdanje do sada. Ova misterioznost privlači pažnju i investicije.

„To je mačični trik“, rekla je nedavno Emilija M. Bender, računski lingvista sa Univerziteta u Vašingtonu i istaknuti kritičar AI industrije. Prosečan korisnik modela o1 možda neće primetiti veliku razliku u poređenju sa prethodnim modelima, poput GPT-4o, za koji je OpenAI tvrdio da predstavlja značajnu nadogradnju, ali nije doneo revolucionarne promene.

Sa modelom o1, situacija se promenila

Međutim, sa modelom o1, situacija se promenila. Nekoliko nezavisnih istraživača, iako manje entuzijastično, priznalo je da program predstavlja „potpuno novu igru“ i „pravu inovaciju“.

Čak i ako kapaciteti ovih modela nisu znatno veći od prethodnih, ulozi za OpenAI su značajno veći. Kompanija se nedavno suočila s talasom kontroverzi i odlazaka visokoprofilnih stručnjaka, dok je napredak u industriji AI-a usporen.

Proizvodi različitih kompanija postali su gotovo identični, a konkurencija pokušava da pronađe nove načine za unapređenje svojih tehnologija.

Nova paradigma: Predikcija i razumevanje

Već mesecima istražujem kako OpenAI vidi budućnost generativne AI tehnologije. Još od ovog proleća, kada je kompanija promovisala svoje napore u razvoju takozvane multimodalne AI—koja funkcioniše s tekstom, slikama i drugim vrstama medija—razgovarao sam sa zaposlenima u OpenAI-u, intervjuisao spoljne stručnjake iz oblasti računarskih i kognitivnih nauka i proučavao istraživanja i saopštenja kompanije.

Lansiranje modela o1 pružilo je najjasniji uvid do sada u to kakvu „inteligenciju“ OpenAI i slične kompanije veruju da grade.

Kompanija je bila neobično direktna u vezi s tim da je serija o1 njihova budućnost. Čen, koji je od tada unapređen u višeg potpredsednika za istraživanja, izjavio je da je OpenAI sada fokusiran na ovu „novu paradigmu“.

Altman je kasnije napisao da kompanija „prioritizuje“ o1 i njegove naslednike. Veruju, ili žele da korisnici i investitori veruju, da su pronašli novu magiju. Doba GPT-a ustupa mesto dobu rezonovanja.

Granica između predikcije i razumevanja

U proleće sam upoznao Marka Čena u renoviranoj fabrici majoneza koja sada služi kao sedište OpenAI-a u San Francisku.

Razgovarali smo preko Zoom-a nekoliko nedelja ranije, dok je on predvodio tim zadužen za prevazilaženje „velikih prepreka“ na putu ka veštačkoj opštoj inteligenciji (AGI)—tehnologiji dovoljno pametnoj da dostigne ili nadmaši ljudsku sposobnost razmišljanja.

Želeo sam da ga pitam o ideji koja je bila ključna za čitavu generativnu AI revoluciju: moć predikcije.

Veliki jezički modeli koji pokreću ChatGPT i slične chatbotove „uče“ upijanjem ogromnih količina teksta, određivanjem statističkih odnosa između reči i fraza, i korišćenjem tih obrazaca za predviđanje sledeće reči u rečenici.

Ovi programi su napredovali kako su se širili—dodavanjem više podataka za obuku, većeg broja procesora i veće količine električne energije. Najnapredniji modeli, poput GPT-4o, sada su u stanju da pišu radne beleške, kratke priče, rešavaju zagonetke i sumiraju tabele.

Koraci iznad pukog prepoznavanja obrazaca

Mark Čen tvrdi da „predikcija vodi ka razumevanju“—da kako bi završio priču ili naslikao portret, AI model mora da razume osnovne principe zapleta, ličnosti, izraza lica i teorije boja.

Istraživanja takođe pokazuju da napredni AI modeli mogu razviti unutrašnje mreže koje odgovaraju određenim temama, idejama ili pojmovima, što se smatra korakom iznad pukog prepoznavanja obrazaca. Ovo objašnjava zašto su mnogi u industriji toliko optimistični u vezi sa predikcijom kao osnovnim principom generativne AI tehnologije.

Sora:Model za generisanje videa

Vrhunac hipoteze predviđanja mogao bi biti Sora, model za generisanje video sadržaja koji je OpenAI predstavio u februaru. Ovaj model kreira klipove tako što predviđa i generiše niz frejmova.

Bil Pibls i Tim Bruks, vodeći istraživači projekta Sora, objasnili su da je cilj ovog modela da stvara realistične video zapise simuliranjem okruženja i ljudi koji se kreću kroz njih. (Bruks je u međuvremenu napustio OpenAI i sada radi na modelima za generisanje video sadržaja u Google DeepMind-u.)

Na primer, za pravljenje video zapisa fudbalske utakmice, Sora bi morala ne samo da prikaže loptu koja odskače od kopački, već i da razvije modele fizike, taktike i razmišljanja igrača.

„Ako uspemo da unesemo sve informacije na svetu u ove modele, to bi trebalo da bude dovoljno da oni izgrade modele fizike i nauče da razmišljaju poput ljudi“, rekao je Pibls. Na taj način, predviđanje bi moglo da dovede do inteligencije. Pragmatično gledano, multimodalnost se može posmatrati i kao proširenje izvora podataka—od svih tekstova na internetu do fotografija i video zapisa.

Reletavizacija razumevanja realnosti od strane veštačke inteligencije

Međutim, samo zato što istraživači OpenAI-a tvrde da njihovi programi razumeju svet, ne znači da je to zaista slučaj. Generisanje video zapisa mačke ne znači da AI išta zna o mačkama—samo da može da napravi video mačke.

(Čak i to ponekad predstavlja izazov: na jednom demo prikazu ranije ove godine, Sora je generisala mačku sa trećom prednjom nogom.) Slično tome, „predviđanje teksta ne znači nužno da [model] razume tekst“, objasnila je Melani Mičel, naučnica za kompjutersku nauku i stručnjak za AI kogniciju u Institutu Santa Fe.

Na primer, GPT-4 je daleko bolji u pravljenju akronima koristeći početna slova svake reči u frazi nego druga slova, što sugeriše da model ne razume pravilo iza pravljenja akronima, već samo imitira ono što je video mnogo puta.

Kada GPT-4 pogreši brojanje slova „r“ u reči strawberry, ili kada Sora generiše video čaše soka koja se topi u sto, teško je poverovati da bilo koji od ovih programa razume fenomene i ideje koje stoje iza njihovih izlaza.

Da li AI može da parira ljudskom umu?

Ove slabosti dovele su do oštrih kritika da AI ne može da parira ljudskom umu—modeli su samo „stohastički papagaji“, kako je to poznato rekao Bender, ili supernapredne verzije funkcije „autokomplet“, kako kaže kritičar AI-a Geri Markus.

Altman je na to odgovorio objavom na društvenim mrežama: „Ja sam stohastički papagaj, a i vi ste,“ implicirajući da je ljudski mozak sofisticirana mašina za predviđanje reči.

Altmanova tvrdnja je očigledno neosnovana; niz koda koji se pokreće u data centru nije isto što i mozak. Ali jednako je besmisleno odbaciti generativni AI—tehnologiju koja redefiniše obrazovanje i umetnost, bilo na bolje ili na gore—kao „puku“ statistiku. Bez obzira na to, neslaganje zamagljuje važniju poentu.

OpenAI-ju ili njegovim investitorima nije važno da li AI napreduje ka tome da liči na ljudski um, ili čak da li njihovi modeli „razumeju“ svoje izlaze—bitno je samo da proizvodi nastavljaju da se razvijaju.

o1: Novi pristup razmišljanju AI modela

Novi modeli za rezonovanje koje je predstavio OpenAI pokazuju dramatično poboljšanje u rešavanju problema iz oblasti kodiranja, matematike i nauke, zadobivši pohvale genetičara, fizičara, ekonomista i drugih stručnjaka. Međutim, o1 model nije osmišljen da bude bolji u predviđanju reči.

Ograničenja trenutnog tehničkog pristupa

Prema istraživanjima koje su sproveli The Information, Bloomberg, TechCrunch i Reuters, vodeće AI kompanije poput OpenAI, Google-a i Anthropic-a suočavaju se s ograničenjima trenutnog tehničkog pristupa.

Modeli za predviđanje reči, poput -4, više ne postaju pouzdano sposobniji, čak ni „inteligentniji“, s povećanjem veličine. Kompanije možda ostaju bez visokokvalitetnih podataka za obuku modela, a čak i kada ih imaju, daljnje povećavanje veličine modela ne donosi značajna poboljšanja. o1 je prvi veliki pokušaj industrije da prevaziđe ovu prepreku.

Mark Čen, s kojim sam razgovarao nakon o1 debija u septembru, rekao mi je da su GPT 4 bazirani programi imali „osnovni jaz koji smo pokušavali da rešimo.“ Dok su prethodni modeli obučavani „da budu veoma dobri u predviđanju onoga što su ljudi zapisali u prošlosti,“ o1 je drugačiji.

„Način na koji obučavamo ‘razmišljanje’ nije imitacijsko učenje,“ objasnio je. Model za rezonovanje nije obučen da predviđa ljudske misli, već da ih proizvodi, ili barem simulira.

Nova era u razvoju AI

Prema mišljenju nezavisnih istraživača i testova, o1 serija se čini „kategorijalno drugačijom“ od starijih GPT serija. Delip Rao, istraživač sa Univerziteta u Pensilvaniji, povezuje ovaj model s rastućim istraživanjem AI rezonovanja, uključujući rad Ilje Sutskevera, bivšeg glavnog naučnika OpenAI-a.

Proces obuke o1 modela podseća na šahovski AI koji igra milion partija kako bi naučio optimalne strategije, ili na pacova koji, trčeći kroz 10.000 lavirinata, razvija dobru strategiju za izbor pravca.

Za razliku od modela za predviđanje reči, poput Claudea-a i ranijih verzija ChatGPT-a, koji generišu reči bez pauze, o1 radi drugačije. Ovaj model istražuje različite puteve dok ne pronađe najbolji.

Kako je objasnio Majk Knup, softverski inženjer i suosnivač takmičenja za testiranje sposobnosti AI modela, o1 koristi više vremena i resursa ne samo tokom obuke, već i tokom upotrebe, da bi pretražio potencijalne „lance rezonovanja.“

Razlika između papagaja i pacova

Možemo posmatrati razliku između jezičkih i rezonovnih modela kroz analogiju papagaja i pacova. ChatGPT i slični proizvodi—„stohastički papagaji“—dizajnirani su da pronalaze obrasce u ogromnim količinama podataka. o1 je „pacov“ koji navigira tim statističkim modelima kako bi rešavao probleme.

Kao u šahu: možete igrati koristeći memorisane poteze, ali to se razlikuje od pravog razumevanja strategije i reagovanja na protivnika. Dok jezički modeli uče gramatiku i možda nešto o svetu, rezonovni modeli pokušavaju da koriste tu gramatiku za rešavanje problema.

Razmišljanje možda zaista predstavlja način da se probije zid na koji su modeli predviđanja izgleda naišli; mnogi iz tehnološke industrije svakako žure da slede primer OpenAI-ja. Ipak, veliko oslanjanje na ovaj pristup moglo bi biti preuranjeno.

Uprkos svojoj grandioznosti, model o1 ima neka poznata ograničenja

Kao i kod modela baziranih na predviđanju, lakše se snalazi sa zadacima za koje postoji više primera u podacima za obuku, kako je izjavio Tom Mekoj, računski lingvista sa Univerziteta Jejl, koji je detaljno testirao verziju o1 objavljenu u septembru.

Na primer, program bolje dešifruje kodove kada je odgovor gramatički ispravna rečenica, umesto nasumičnog skupa reči – prvi slučaj je verovatno bolje zastupljen u podacima za obuku. Statistička osnova ipak ostaje.

Fransoa Šole, bivši računski naučnik iz Google-a, koji proučava opštu inteligenciju i jedan je od osnivača takmičenja u AI rezonovanju, objasnio je drugačije: „Model poput o1 … može da postavlja sopstvena pitanja kako bi poboljšao način na koji koristi ono što zna. Ali i dalje je ograničen na ponovno primenjivanje onoga što već zna.“

Brojne nezavisne analize to potvrđuju

Na takmičenju u rezonovanju veštačke inteligencije, o1 se pokazao boljim od GPT-4o, ali je i dalje imao poteškoća sa rešavanjem problema koji testiraju apstraktno rezonovanje. Istraživači iz kompanije Apple nedavno su otkrili da dodavanje nebitnih rečenica matematičkim zadacima povećava verovatnoću da o1 odgovori netačno.

Na primer, kada se o1 traži da izračuna cenu hleba i mafina, dodavanje informacije da planirate da deo proizvoda donirate – iako to ne utiče na cenu – zbunjuje model. o1 možda ne razume strategiju šaha duboko koliko primenjuje široka pravila i taktike koje je zapamtio.

Čak i ako prihvatimo tvrdnju da o1 razume, umesto da imitira logiku koja stoji iza njegovih odgovora, program možda zapravo zaostaje za opštom inteligencijom više nego što to čini ChatGPT.

OpenAI razmišlja dugoročno

Poboljšanja modela o1 ograničena su na specifične oblasti u kojima se može potvrditi tačnost rešenja – poput matematičkih dokaza ili testiranja kompjuterskog koda na greške. Ne postoji objektivan kriterijum za lepu poeziju, ubedljivu retoriku ili emocionalnu empatiju na osnovu kojih bi se model obučavao.

To verovatno čini o1 šturijim od GPT-4o, kako kaže Rao sa Univerziteta u Pensilvaniji. Čak je i OpenAI u svom blogu nagovestio ovo, izjavljujući: „Za mnoge uobičajene slučajeve GPT-4o će biti sposobniji na kratak rok.“

Međutim, OpenAI razmišlja dugoročno. Modeli rezonovanja „istražuju različite hipoteze kao što bi to učinio čovek“, rekao je Čen. Zahvaljujući rezonovanju, o1 pokazuje bolju sposobnost razumevanja i odgovaranja na pitanja o slikama, naveo je, a puna verzija o1 sada prihvata multimodalne unose.

Rezonovanje problema na račun sličan ljudskom

Novi modeli rezonovanja rešavaju probleme „na način sličan ljudskom“, napisao je OpenAI u septembru. Ako se zaista pokazuje da povećanje velikih jezičkih modela dolazi do zida, ovaj vid rezonovanja izgleda kao sledeći korak na koji se mnogi OpenAI-ovi rivali takođe oslanjaju.

Dario Amodei, direktor kompanije Anthropic, nedavno je označio o1 kao mogući put napred za AI. Gugl je nedavno objavio nekoliko eksperimentalnih verzija modela Gemini, svog vodećeg modela, od kojih sve pokazuju znake „miševa u lavirintu“ – duže odgovaranje na pitanja, detaljne lance rezonovanja, poboljšanja u matematici i kodiranju. I Microsoft i kineske kompanije, poput Alibabe, istražuju ovaj „rezonujući“ pristup.

Da li je ovo put ka superinteligenciji?

Ako je ovo put ka superinteligenciji, on je neobičan. „Ovo se vraća na priču o milion majmuna koji kucaju milion godina kako bi stvorili Šekspirova dela“, rekla je Emili Bender. Ali tehnologija OpenAI-a efektivno sabija te godine u sekunde.

Kompanijski blog se hvali da je o1 postigao bolji rezultat od većine ljudi na nedavnom testu kodiranja koji je omogućavao 50 rešenja po problemu – ali samo kada je o1 imao pravo na 10.000 pokušaja. Nijedan čovek ne bi mogao da smišlja toliko mogućnosti u razumnom vremenskom periodu, što je upravo poenta.

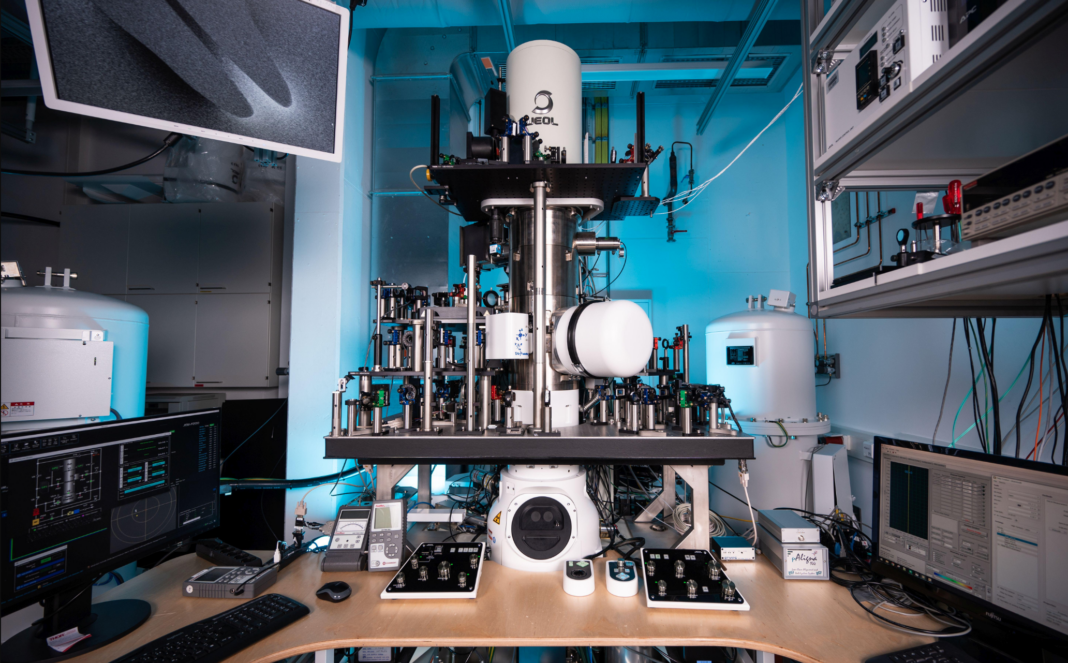

Za OpenAI, neograničeno vreme i resursi su prednost koju njihovi modeli imaju u odnosu na biologiju. Nepunih dve nedelje nakon lansiranja o1, kompanija je predstavila planove za izgradnju centara za obradu podataka koji bi zahtevali snagu pet velikih nuklearnih reaktora – dovoljno za gotovo 3 miliona domaćinstava.

Ipak, i ovi „miševi u lavirintu“ možda će naići na zid. U ranim testovima OpenAI-a, skaliranje o1-a pokazalo je opadajući povrat: Linearna poboljšanja na zahtevnom matematičkom ispitu zahtevala su eksponencijalno povećanje računarske snage.

Činjenica da superinteligencija može koristiti toliko električne energije da bi zahtevala globalno preuređenje elektroenergetskih mreža – i da takvi zahtevi trenutno uzrokuju ogromne finansijske gubitke – očigledno ne predstavljaju prepreku ni za startap, ni za njegove investitore.

Ambicija prevazilazi tehnologiju. Možda ispod svega ima supstance, čak i inteligencije. Ali za ovaj spekulativni ciklus, ona nije ni potrebna da bi se zavrteo visoko očekivani točak rasta.